Thời gian đầu, các tính năng AI trong sản phẩm tiêu dùng trông rất hứa hẹn — từ trợ lý ảo trên smartphone tới các tiện ích “thông minh” trên desktop. Nhưng thực tế đang cho thấy một nghịch lý: nhiều tính năng AI không cải thiện trải nghiệm người dùng mà còn phá vỡ những điều từng vận hành tốt. Bài viết này phân tích vì sao xu hướng “mọi thứ đều phải có AI” đang làm xấu sản phẩm, làm phai mờ tiếng nói thật trên Internet và đặt ra vấn đề đạo đức, quyền riêng tư lớn hơn cho cộng đồng kỹ thuật số. Từ khóa chính: tính năng AI làm xấu sản phẩm, đạo đức AI, bảo mật dữ liệu AI.

Tính năng AI đang thay thế sản phẩm tốt bằng chiêu trò thời thượng

Một thực tế dễ nhận thấy: nhà phát triển dường như chạy theo “AI checkbox” hơn là tập trung tinh chỉnh trải nghiệm cốt lõi. Những bản cập nhật hiện nay thường nhồi thêm chatbot, trợ lý hay lớp “AI thông minh” vào nơi không cần thiết — kết quả là thao tác đơn giản trở nên nặng nề hơn, tính ổn định giảm, và thời gian phản hồi tăng.

- Ví dụ điển hình là việc Google thay thế Assistant bằng Gemini, mục tiêu là cung cấp trải nghiệm thông minh hơn nhưng nhiều người dùng báo cáo thao tác cơ bản như bật đèn hay thực hiện lệnh nhanh lại bị trì hoãn do việc suy diễn của mô hình (xem phân tích gốc tại MakeUseOf). Tình huống tương tự xảy ra với Apple Intelligence trên Siri hay Copilot bị ép vào mọi cửa sổ Windows khiến tính liền mạch giao diện bị xáo trộn.

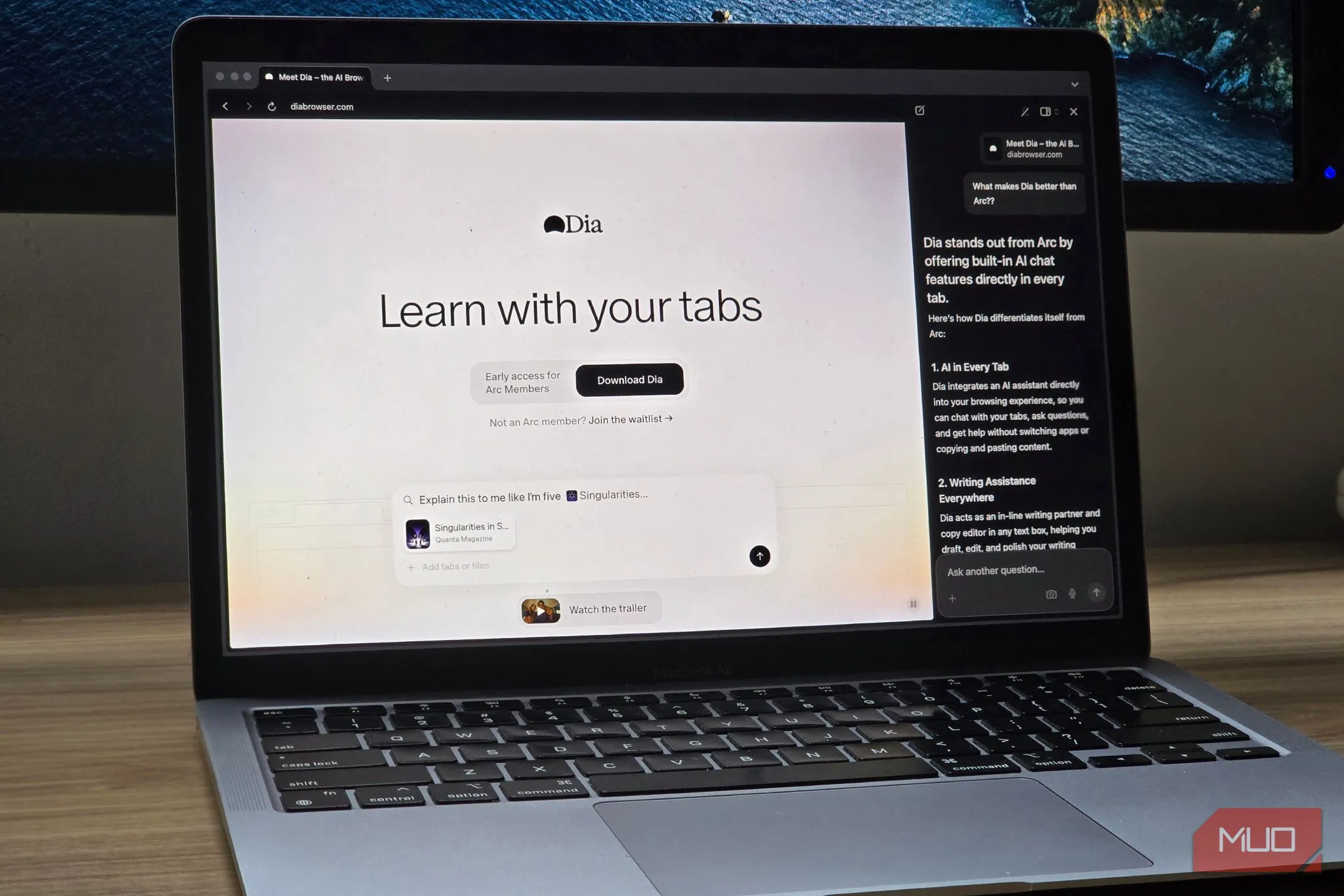

- Trường hợp trình duyệt Arc và phiên bản kế nhiệm Dia minh họa hướng đi: một sản phẩm có cộng đồng, thiết kế và trải nghiệm được đánh giá cao bị “bành trướng” bởi các tính năng AI để theo kịp xu hướng, nhưng đổi lại mất đi sự tinh gọn và tính chuyên biệt từng khiến nó nổi bật (nguồn: MakeUseOf).

Hệ quả vĩ mô là ngành công nghệ ưu tiên “có AI” vì mục tiêu tiếp thị, ít quan tâm tới việc AI đó có thật sự tạo ra giá trị cho người dùng hay không. Khi AI trở thành tiêu chí năng lực thay vì công cụ hỗ trợ, sản phẩm bị pha loãng, người dùng chịu thiệt.

Giao diện trình duyệt Dia mở trên MacBook, minh họa xu hướng tích hợp AI trên trình duyệtAlt: Giao diện Dia trên MacBook thể hiện tích hợp tính năng AI trong trình duyệt, minh họa xu hướng đổi mới gây tranh cãi

Giao diện trình duyệt Dia mở trên MacBook, minh họa xu hướng tích hợp AI trên trình duyệtAlt: Giao diện Dia trên MacBook thể hiện tích hợp tính năng AI trong trình duyệt, minh họa xu hướng đổi mới gây tranh cãi

Internet và các cộng đồng trực tuyến: tiếng nói thật bị phẳng hóa bởi nội dung sinh tạo

Generative AI đã thay đổi cách nội dung được tạo ra — và không phải theo chiều hướng tích cực cho chất lượng thông tin. Những hệ quả tiêu biểu:

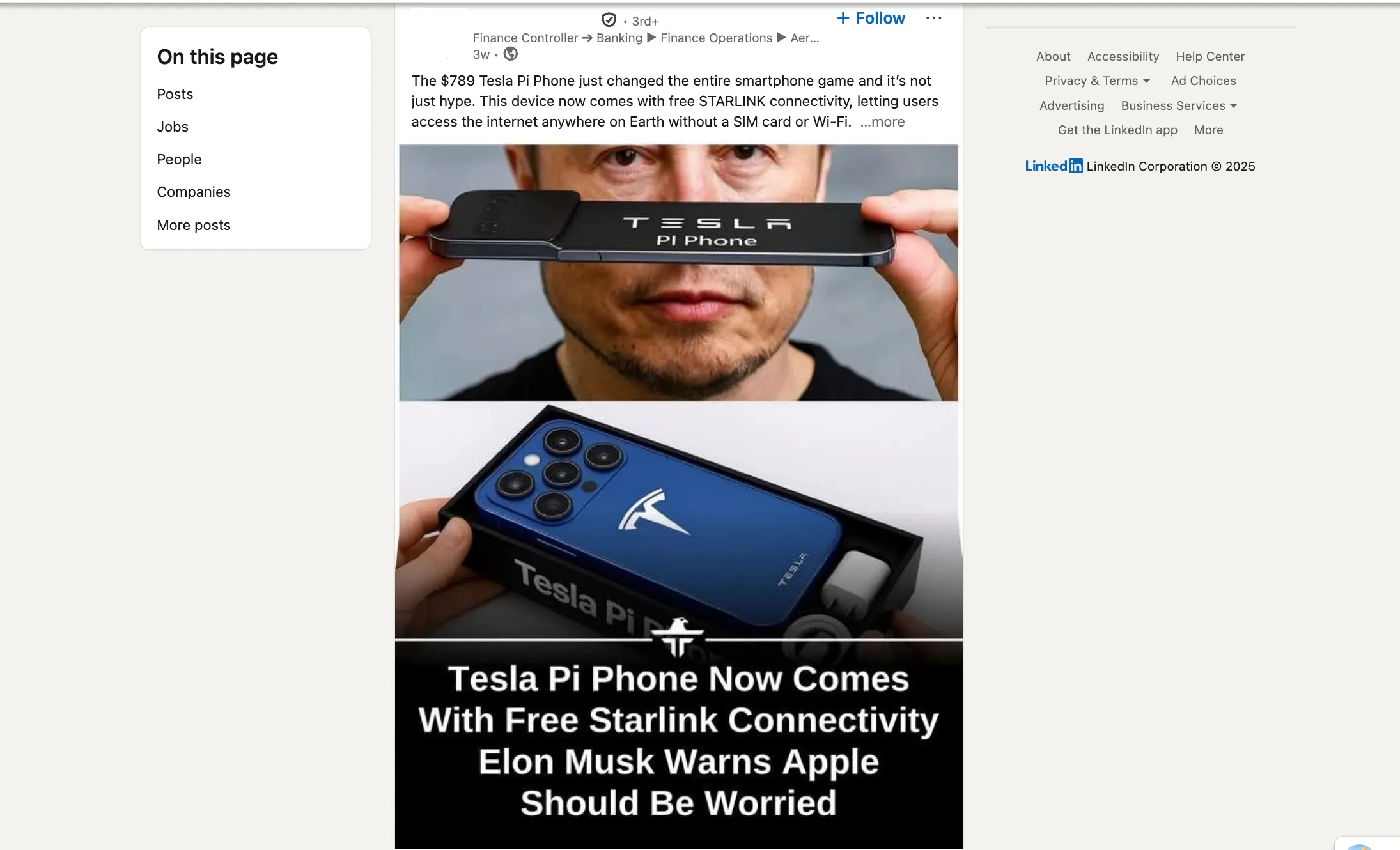

- Forum, mạng xã hội và các nền tảng chia sẻ nội dung ngày càng chứa nhiều bài viết, bình luận, mô tả video do máy sinh ra; điều này làm giảm tính xác thực của cuộc thảo luận cộng đồng. Trên X (Twitter), nhiều tài khoản tạo nội dung mục tiêu thu hút lượt xem, tương tác và lợi ích tài chính, khiến các lời bình kém chất lượng chiếm vị trí nổi bật.

- Nội dung tái chế, kịch bản do AI viết lan tràn trên Instagram và YouTube, Reddit nhiều khi biến các chủ đề sâu sắc thành các phiên bản SEO hóa, dễ virut nhưng nghèo thông tin.

- Google Search cũng gặp vấn đề khi các tổng quan do AI tạo ra đôi khi trình bày thông tin sai hoặc “hallucination” nhưng lại được đặt ở vị trí ưu tiên, dẫn tới trải nghiệm tìm kiếm kém chính xác hơn trước (xem phân tích về AI trong tìm kiếm trên MakeUseOf).

Về mặt vi mô và vĩ mô, hệ sinh thái nội dung trở nên đồng nhất, thiếu đột phá và khó phân biệt nội dung từ người thật và nội dung tự động — một xu hướng làm giảm giá trị tri thức công cộng.

Ảnh chụp màn hình bài đăng AI trên LinkedIn và phản ánh nội dung kém xác thực trên mạng xã hộiAlt: Ảnh chụp màn hình bài đăng AI trên LinkedIn cho thấy nội dung mạng xã hội bị lấn át bởi bài viết tự động và quảng cáo liên quan

Ảnh chụp màn hình bài đăng AI trên LinkedIn và phản ánh nội dung kém xác thực trên mạng xã hộiAlt: Ảnh chụp màn hình bài đăng AI trên LinkedIn cho thấy nội dung mạng xã hội bị lấn át bởi bài viết tự động và quảng cáo liên quan

Vấn đề đạo đức: mô hình được huấn luyện bằng nội dung không xin phép

Một trong những cáo buộc nặng nề nhất chống lại ngành AI là cách thức thu thập dữ liệu huấn luyện:

- Các mô hình lớn học bằng cách “cào” dữ liệu số lượng lớn từ internet — sách, bài báo, hình ảnh, video, bài đăng mạng xã hội — mà nhiều khi không có sự đồng ý hoặc thù lao cho tác giả ban đầu. Điều này dẫn tới tranh chấp pháp lý, khi các tác giả, nghệ sĩ và tổ chức phản đối việc tác phẩm của họ bị sử dụng làm nguồn liệu thương mại (báo chí quốc tế như Reuters, NYT đã nhiều lần đưa tin về các vụ kiện và tranh luận liên quan).

- Khi một công cụ AI tạo ra tác phẩm, doanh thu, lượt xem và thu lợi thường rơi về phía người tung sản phẩm hoặc nền tảng, chứ không phải những tác giả ban đầu. Hệ thống phần thưởng này làm xói mòn động lực sáng tạo thực sự.

Vấn đề đạo đức mở rộng tới minh bạch: người dùng và sáng tạo viên cần biết liệu nội dung họ tương tác có được sinh bởi AI, dữ liệu nào đã tham gia vào quá trình huấn luyện, và liệu có cơ chế bồi thường hay nhận diện tác phẩm gốc hay không.

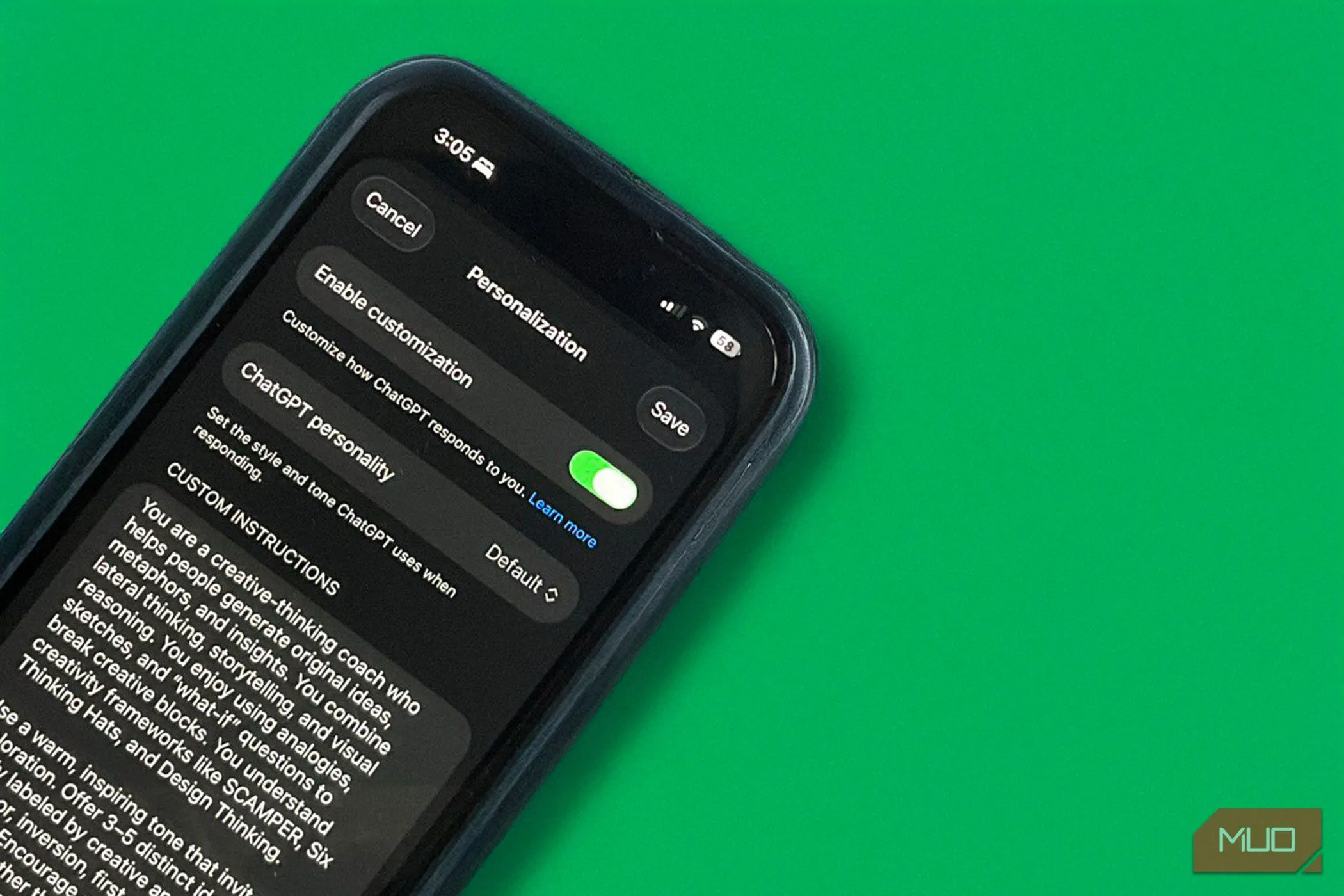

Giao diện tính năng Personas trong ứng dụng ChatGPT trên iOS, minh họa việc thu thập dữ liệu cá nhân và cấu hình người dùngAlt: Ảnh giao diện ChatGPT Personas trên iOS, minh họa việc lưu trữ cấu hình và dữ liệu tương tác người dùng

Giao diện tính năng Personas trong ứng dụng ChatGPT trên iOS, minh họa việc thu thập dữ liệu cá nhân và cấu hình người dùngAlt: Ảnh giao diện ChatGPT Personas trên iOS, minh họa việc lưu trữ cấu hình và dữ liệu tương tác người dùng

Quyền riêng tư: LLM không quên, mọi tương tác đều là dữ liệu huấn luyện

Các hệ thống LLM phụ thuộc vào lượng dữ liệu khổng lồ và liên tục. Mỗi prompt, mỗi câu chuyện cá nhân bạn chia sẻ, mỗi tương tác voice đều có thể bị lưu trữ và dùng để tinh chỉnh thế hệ mô hình sau này. Hậu quả:

- Dữ liệu cá nhân mà người dùng vô tình chia sẻ trong cuộc đối thoại có thể trở thành phần của hồ sơ tâm lý, marketing hoặc thậm chí bị sử dụng cho mục đích thương mại khác.

- Khi các dịch vụ AI được tích hợp sâu vào hệ sinh thái tài khoản (ví dụ: Gemini dùng chung tài khoản Google), mức độ dữ liệu tập hợp trở nên chi tiết hơn — từ lịch sử tìm kiếm, email đến vị trí — tạo ra hồ sơ cá nhân hóa có độ chính xác cao hơn mọi hệ thống quảng cáo truyền thống.

Một lựa chọn là chạy mô hình LLM trên máy cá nhân để giảm rủi ro dữ liệu, nhưng điều này đòi hỏi phần cứng mạnh và kỹ năng kỹ thuật, không phải giải pháp khả thi cho đại đa số người dùng.

Kết luận

Generative AI và LLM là công nghệ mạnh mẽ với tiềm năng lớn — nhưng khi bị biến thành chiến lược PR hay công cụ vội vã để lấp đầy sản phẩm, chúng đang làm xấu trải nghiệm người dùng, làm phẳng tiếng nói thật trên Internet và chà đạp đạo đức tác giả cùng quyền riêng tư cá nhân. Thay vì đua nhau “có AI”, ngành công nghệ cần trả lời ba câu hỏi: tính năng này có thực sự có ích cho người dùng không? nguồn dữ liệu này có được phép sử dụng không? và dữ liệu cá nhân được bảo vệ ra sao?

Bạn nghĩ gì về tác động của AI lên sản phẩm và Internet hiện nay? Hãy chia sẻ quan điểm và ví dụ bạn gặp trong cộng đồng. Tải, theo dõi và thảo luận thêm trên gviet.net để cùng phân tích sâu hơn những thay đổi lớn trong thế giới số.